Süni intellekt texnologiyalarının sürətli inkişafı informasiya imkanlarını genişləndirsə də, paralel olaraq yeni təhlükələri de meydana çıxarır. Son günlər sosial medianın Azərbaycan seqmentində yayılan məlumatlar göstərir ki, deepfake artıq təkcə siyasi manipulyasiya və maliyyə fırıldağı aləti deyil, birbaşa şəxsləri hədəf alan kiberdələduzluq, təzyiq mexanizminə çevrilib.

Deepfake mexanizmi necə işləyir?

Son günlərdə Bakı Dövlət Universitetinin Hüquq fakültəsində təhsil alan bir qrup tələbə qızın sosial şəbəkələrdə paylaşdıqları fotolardan icazəsiz istifadə olunub. Naməlum şəxs və ya qrup həmin şəkilləri süni intellekt vasitəsilə montaj edərək təhqiramiz formada yayımlayıb.

MÖVZU İLƏ BAĞLI:

Bu haker qruplaşma Azərbaycanı hədəf alıb - Kiberhücumlarla bağlı RƏSMİ XƏBƏRDARLIQ

Zərərçəkənlər bildirirlər ki, bəzi hallarda şəkillərin mənbəyi belə bilinmir. Hətta sosial media hesabında foto paylaşmayan şəxslərin də görüntüləri saxtalaşdırılır. Daha sonra isə onlardan sözügedən materialların silinməsi müqabilində pul tələb olunur. Lakin tələbələr videoları silmək üçün pul təklif etdikdə, naməlum şəxs heç bir maliyyə səbəbinin olmadığını iddia edir.

Bu cür hesabların əsasən gecələr göründüyü bildirilir. Bu müddət ərzində səhifələrdə redaktə edilmiş şəkillər və videolar dərc olunur, bundan sonra hesablar səhərə qədər silinir və ya deaktiv edilir. Sosial media istifadəçilərinin sözlərinə görə, ardıcıl olaraq yaradılan bir neçə belə səhifə var ki, bu da onları izləməyi çətinləşdirir.

Məsələ ilə bağlı hüquq-mühafizə orqanları tərəfindən araşdırma aparılıb və sözügedən əməli törədən şəxs saxlanılıb.

Qeyd edək ki, oxşar vəziyyət daha əvvəl – ötən ilin martında Azərbaycan Tibb Universitetinin tələbələrinin də başına gəlmişdi. O zaman da tələbələrin adından saxta səhifələrin yaradılması, şəkillərin icazəsiz paylaşılması və təhqiramiz məzmunun yayılması barədə müraciətlər olmuşdu. Bu isə göstərir ki, problem təkcə bir ali məktəblə məhdudlaşmır və daha geniş tendensiyanın əlamətidir.

Dünyadakı ən böyük “deepfake” qalmaqalları

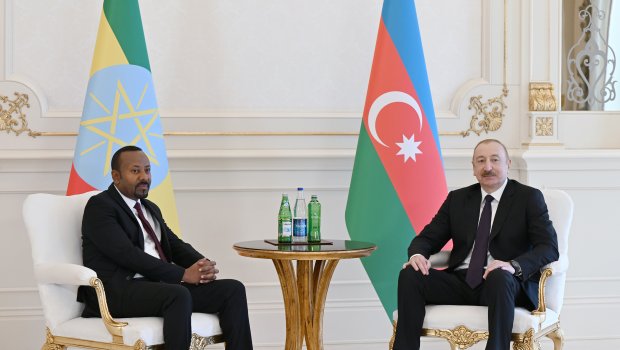

Qeyd edək ki, dünya təcrübəsində “deepfake” qalmaqalları daha çox siyasi və iqtisadi müstəvidə müşahidə olunub. Belə ki, 2024-cü ildə ABŞ-da seçki ərəfəsində Co Baydenin səsinə bənzər deepfake robocall yayıldı. Zəngdə seçicilərə ilkin seçkilərdə iştirak etməmək tövsiyə olunurdu. Slovakiya və Hindistanda seçki kampaniyalarında da oxşar “taktika”dan istifadə olunub.

Sözügedən hallardan dələduzlar daha çox istifadə edirlər. Hətta bu yolla insanların milyonlarla dollarını ələ keçirənlər də olub.

Belə ki, 2021-ci ildə Birləşmiş Ərəb Əmirliklərində deepfake texnologiyası səs klonlama (voice cloning) üsulu ilə maliyyə fırıldaqçılığı baş verib. Şirkətlərdən birinin CEO-nun səsini klonlayan dələduzlar, şirkət əməkdaşını aldadaraq, 35 milyon dolları öz hesablarına köçürməyə nail olublar.

2024‑cü ilin əvvəllərində isə “Arup” şirkətinin Honq Konqdakı filialı süni intellekt (AI) texnologiyası ilə həyata keçirilmiş çox ciddi maliyyə fırıldaqçılığına məruz qalıb. Şirkətin mühasibi elektron poçtla gələn ilkin bildirişdən sonra video konfransa qoşulub. Bu zaman şirkətin baş maliyyə direktoru və digər rəhbər şəxslərinin deepfake (AI tərəfindən yaradılmış) görüntüləri ilə qarşılaşıb və bu şəxslərin həqiqətən də iş yoldaşları olduğunu düşünüb. Mühasib onlara inanaraq, 25 milyon dollar vəsaiti təqdim edilən hesablara köçürüb.

Qlobal təcrübə: tələbələr necə hədəf alınır?

Tələbələri hədəf alan deepfake halları da qlobal miqyasda artmaqdadır. Xüsusilə tələbə qızların fotolarının manipulyasiyası və saxta hesabların yaradılması bir çox ölkədə ciddi rezonans doğurub.

Son illərdə ABŞ-da bir neçə ştatda məktəb və universitet tələbələrinin şəkillərinin süni intellektlə saxtalaşdırılması halları qeydə alınıb. Sosial mediadan götürülən fotolar üzərində manipulyasiya aparılaraq şantaj və alçaltma məqsədilə yayılıb.

2024-cü ildə Cənubi Koreyada Telegram qruplarında tələbə və məktəbli qızların fotolarının deepfake vasitəsilə dəyişdirilərək yayılması böyük rezonans doğurub. Kanallarda həm orta məktəb, həm universitet tələbələrinin və müəllimlərin şəkillərindən icazəsiz istifadə edilərək deepfake pornoqrafik materiallar yaradılıb və paylaşılıb.

Ötən ilin oktyabrında İndoneziyada SMAN 11 Semarang orta məktəbinin şagirdlərinin üzləri və müəllimlərin görüntüləri deepfake texnologiyası ilə pornoqrafik videolara montaj olunaraq sosial şəbəkədə yayılıb. Məktəblilər və məzunlar hadisə ilə bağlı polisə müraciət edib, məsələ ictimailəşdikdən sonra bölgədə etirazlar başlayıb.

Oxşar hallar Yaponiya və Böyük Britaniya kimi ölkələrdə də yaşanıb.

Bütün sosial şəbəkə istifadəçiləri risk altındadır

Deepfake texnologiyasının yaratdığı təhlükə artıq konkret sosial qrupla məhdudlaşmır. Əgər ilkin mərhələdə əsas hədəf siyasətçilər və tanınmış şəxslər idisə, bu gün süni intellekt alətləri hər kəsi potensial hədəfə çevirir. İstənilən açıq profil fotosu, qısa video çıxış və ya səs yazısı manipulyasiya üçün kifayət edə bilər. Bu isə o deməkdir ki, məsələ təkcə tələbələrin deyil, bütövlükdə cəmiyyətin informasiya təhlükəsizliyi problemidir.

Risklər çoxşaxəlidir. Birincisi, şəxsi həyatın toxunulmazlığı pozulur və insanın razılığı olmadan onun adından saxta məzmun hazırlanır. İkincisi, reputasiya riski yaranır – saxta görüntü və ya səs yazısı bir neçə saat ərzində geniş auditoriyaya yayıla və real fakt kimi qəbul edilə bilər. Üçüncüsü, deepfake şantaj və maliyyə təzyiqi alətinə çevrilir. Dördüncüsü isə daha təhlükəli tendensiya ortaya çıxır: informasiya mühitində etimad böhranı formalaşır. Artıq insanlar gördükləri və eşitdikləri materialın həqiqiliyinə şübhə ilə yanaşmağa başlayırlar.

Xüsusilə sosial şəbəkələrin geniş yayılması və süni intellekt alətlərinin əlçatan olması deepfake istehsalını ucuz və sürətli prosesə çevirib. Bu, yalnız gəncləri deyil, dövlət qulluqçularını, sahibkarları, müəllimləri, jurnalistləri və hətta məktəbliləri belə risk altında saxlayır. Yəni məsələ fərdi yox, ümumi xarakterlidir.

Çözüm nədir?

Deepfake-lə mübarizə təkcə hüquq-mühafizə orqanlarının işi deyil və yalnız ayrı-ayrı cinayət işlərinin açılması ilə problem aradan qalxmır. Burada paralel və sistemli yanaşma tələb olunur.

Rəqəmsal savadlılıq cəmiyyət miqyasında artırılmalıdır. İnsanlar bilməlidir ki, internetdə yerləşdirilən hər bir açıq foto və video potensial olaraq manipulyasiya oluna bilər. Məxfilik ayarlarının gücləndirilməsi, iki mərhələli autentifikasiya və şəxsi məlumatların paylaşımına ehtiyatla yanaşma artıq seçim deyil, zərurətdir.

Sosial media platformaları daha aktiv məsuliyyət daşımalıdır. Deepfake məzmunun avtomatik aşkarlanması, sürətli bloklama mexanizmləri və istifadəçi şikayətlərinə operativ reaksiya vacibdir. Texnologiya problemi yaradıbsa, həllin bir hissəsi də yenə texnologiya olmalıdır.

Hüquqi baza təkmilləşdirilməlidir. Deepfake vasitəsilə şantaj, reputasiya zərbəsi və maliyyə fırıldağı halları ayrıca hüquqi çərçivədə qiymətləndirilməli, cəza mexanizmləri konkret və çəkindirici olmalıdır.

Nəhayət, ən vacib məsələ ictimai şüurdur. Deepfake artıq “kimsə ilə bağlı problem” deyil. Bu, hər bir internet istifadəçisinin qarşılaşa biləcəyi riskdir. Ona görə də məsuliyyət də kollektivdir: fərdi təhlükəsizlik vərdişləri, institusional mexanizmlər və hüquqi sistem paralel şəkildə işləməlidir. Əks halda, süni intellektin imkanları artdıqca, manipulyasiya alətləri də daha təhlükəli və daha genişmiqyaslı xarakter alacaq.

Bizim.Media-nın analitik qrup